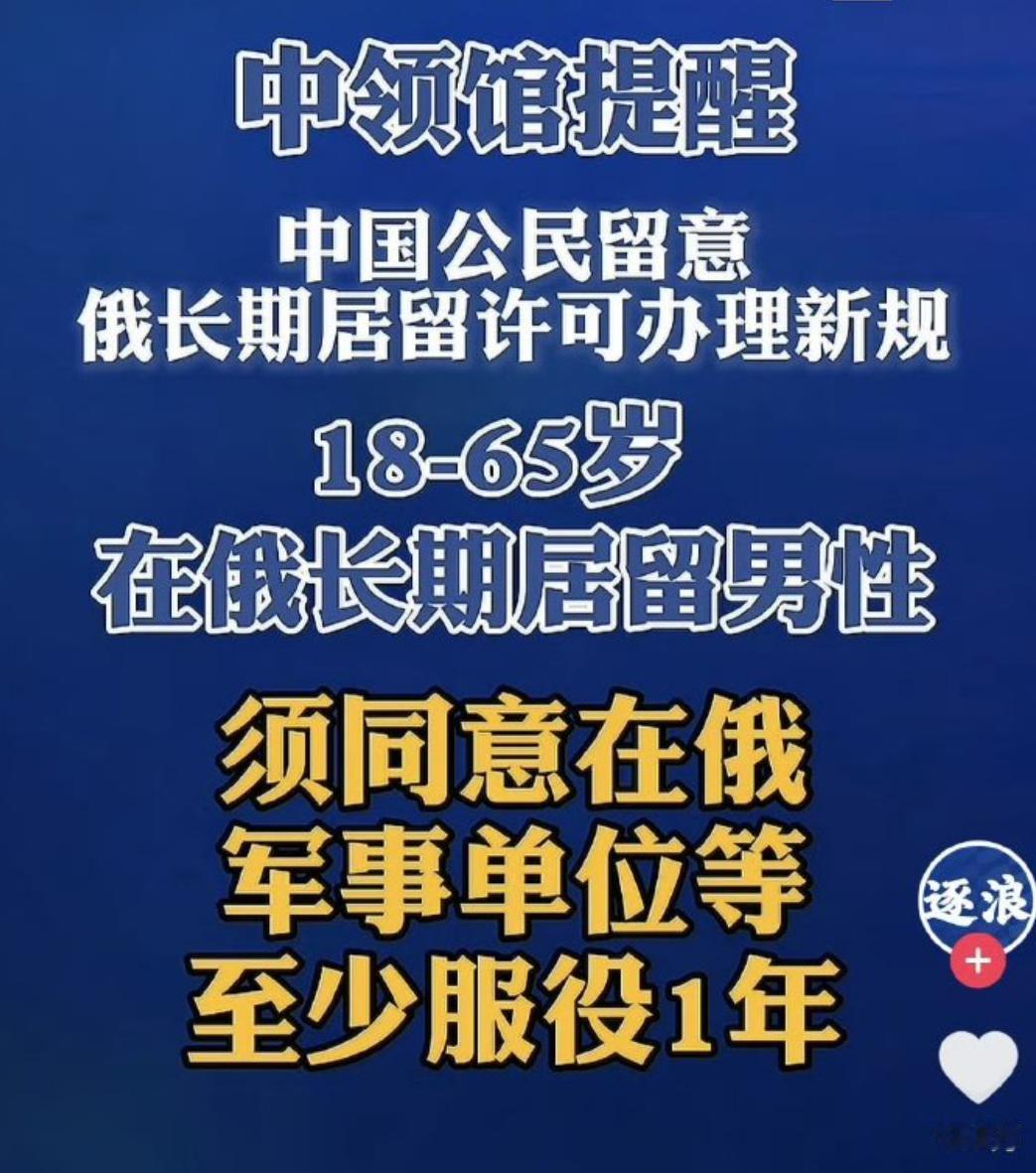

中方三次提议约束致命机器人,均遭美英印俄拒绝,现在这些国家后悔大了! 可能很多人还没弄明白,咱们说的致命机器人,不是电影里那种张牙舞爪的人形终结者,说白了就是不用人实时操控,能自己识别目标、判断局势,甚至自主发动攻击的家伙,像自主攻击无人机、无人战车、无人潜航器这些,都算其中一员。 这种东西一旦失控,后果根本没法预料,机器没有伦理判断,分不清平民和战斗人员,哪怕只是算法出个小错,或者被黑客劫持,都可能造成无差别伤害,而且真出了事儿,连该追究谁的责任都找不到。 早在2014年,中方就已经意识到了这种风险,在瑞士日内瓦举行的特定常规武器公约框架下的会议上,率先提出要建立国际监管机制,约束这类致命机器人的研发和部署,避免它们脱离人类的有效控制。 那时候人工智能还没像现在这么普及,很多国家还觉得这事儿太超前,没当回事,尤其是美英印俄这四个国家,要么说要“继续观察”,要么强调要“保留技术发展空间”,说白了就是不想被规则束缚。 之后中方又在2016年、2019年两次明确提议,呼吁各国一起谈判,制定有法律约束力的国际文书,禁止或严格限制这类武器。到了2021年,中方更是在日内瓦高级别会议上,提交了一份长达87页的详细提案,把各种风险和约束办法都讲得明明白白,当时就有125个国家表示支持,可美英印俄还是硬气地投了反对票,硬生生拦住了这份提案。 他们当初的心思其实特别好猜,就是觉得自己技术领先,不想被规则捆住手脚,想趁着没约束,赶紧加大研发投入,抢占技术高地,以后在这方面就能说了算。 美国当时已经发布了好几份《无人系统综合路线图》,计划到2030年让60%的地面作战平台实现智能化,还搞了“女武神”无人机、陆上“翼人”机器人车辆这些装备。 俄罗斯也成立了专门的机器人研发机构,“平台-M”履带式机器人、“奥兰-10”无人机都陆续亮相,还计划到2025年让无人武器在其装备体系中占比达到30%。 英国和印度也不甘落后,一个在乌克兰战场投入了排爆无人装备,一个拼命砸钱想跟上节奏,反正就是一门心思要在致命机器人领域压别人一头。 可他们万万没想到,局势反转得这么快,这几年人工智能技术迎来爆发式进步,中国在智能机器人、机器狗等领域一路狂奔,迭代速度快得让人咋舌,各种高性能装备不断亮相,反观他们自己,一个个都掉链子了。 美国花了大价钱搞研发,可很多项目成本高得离谱,根本没法大规模部署,还经常出现人机协同不畅、通信过载的问题,看似先进的技术,实际用起来问题一大堆;俄罗斯的无人战车虽然在叙利亚战场亮过相,但实战适应性太差,很多技术还停留在实验室阶段,动不动就出故障。 印度更别提了,光有规划没实力,预算不足、技术瓶颈突出,这么多年下来,始终停留在初级阶段;英国的无人装备也就只能做点排爆之类的简单活儿,整体规模和技术整合能力,远远达不到自己当初的预期。 更让他们头疼的是,致命机器人的技术门槛越来越低,底层技术大多来自开源社区,商业公司的算法框架也能被二次开发,军民技术的界限越来越模糊,越来越多的国家开始涉足这个领域,他们的技术优势被一点点稀释。 而且没有统一的约束框架,风险也越来越突出,2025年上海举行的GEEKCON大会上,有黑客现场演示,仅凭一句特定的语音指令,就能控制人形机器人,还能让它把攻击指令传给其他同型号的机器人,这种连锁反应要是发生在战场上,后果不堪设想。 其实早在2015年,马斯克、霍金还有苹果联合创始人史蒂夫·沃兹尼亚克等3000多名AI研究人员,就签署公开信要求禁止开发超出人类控制的自主武器,马斯克还多次强调,致命自主武器比核武器还危险,可能会导致武装冲突以更大的规模、更快的速度爆发,可当初美英印俄这四个国家,压根没把这些警告放在眼里。 说来说去,中方当初三次提议约束致命机器人,从来不是为了限制谁的发展,更不是为了自己抢占优势,只是想通过全球协作,规避这类武器带来的风险,守护全人类的安全。可美英印俄当初太贪心、太短视,一门心思只想耍小聪明、抢技术优势,觉得中方的提议是在拖他们后腿,结果聪明反被聪明误,不仅没实现垄断,反而让自己陷入了被动,还让全球面临着更大的安全风险。 现在这些国家的后悔,说白了就是自找的。当初要是能放下偏见,静下心来听听中方的建议,一起制定规则、规避风险,也不至于落到今天这步田地。这也算是给所有国家提了个醒,科技发展越快,越要守住底线,单打独斗、追求霸权,最终只会搬起石头砸自己的脚。