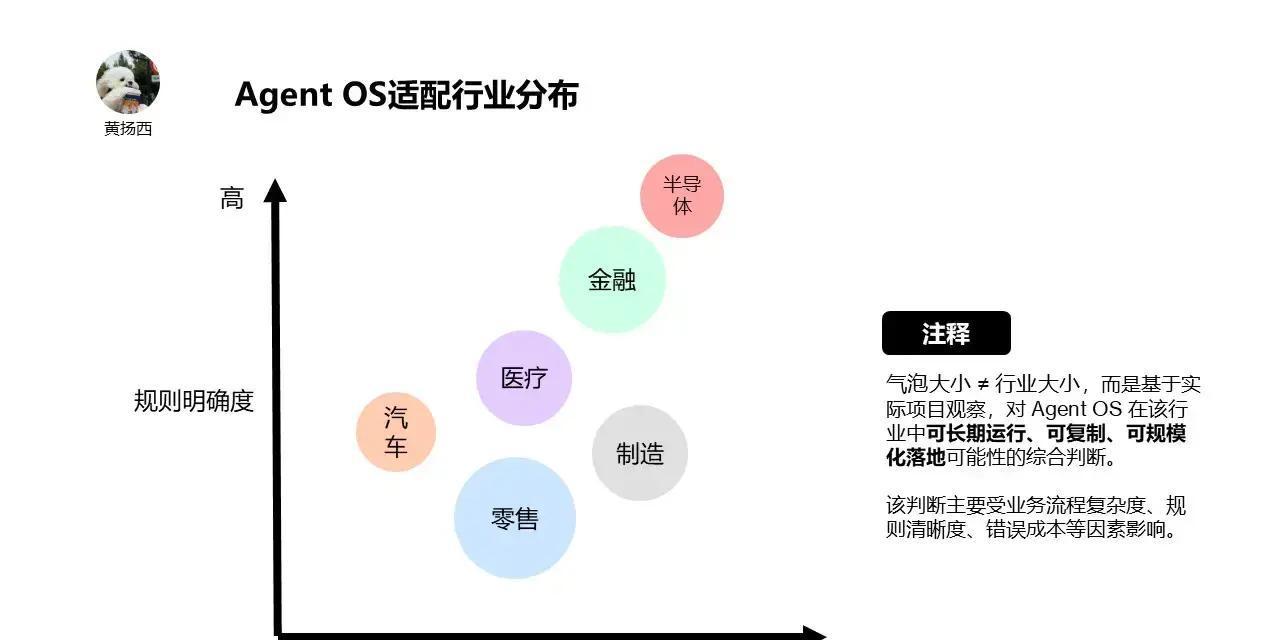

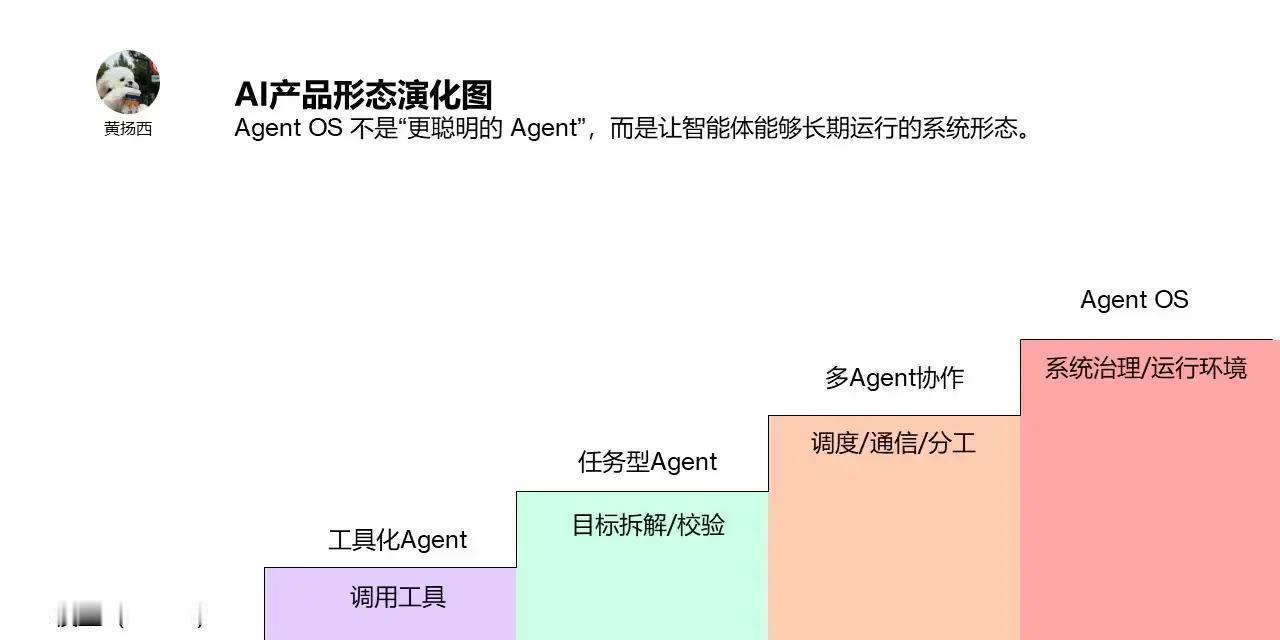

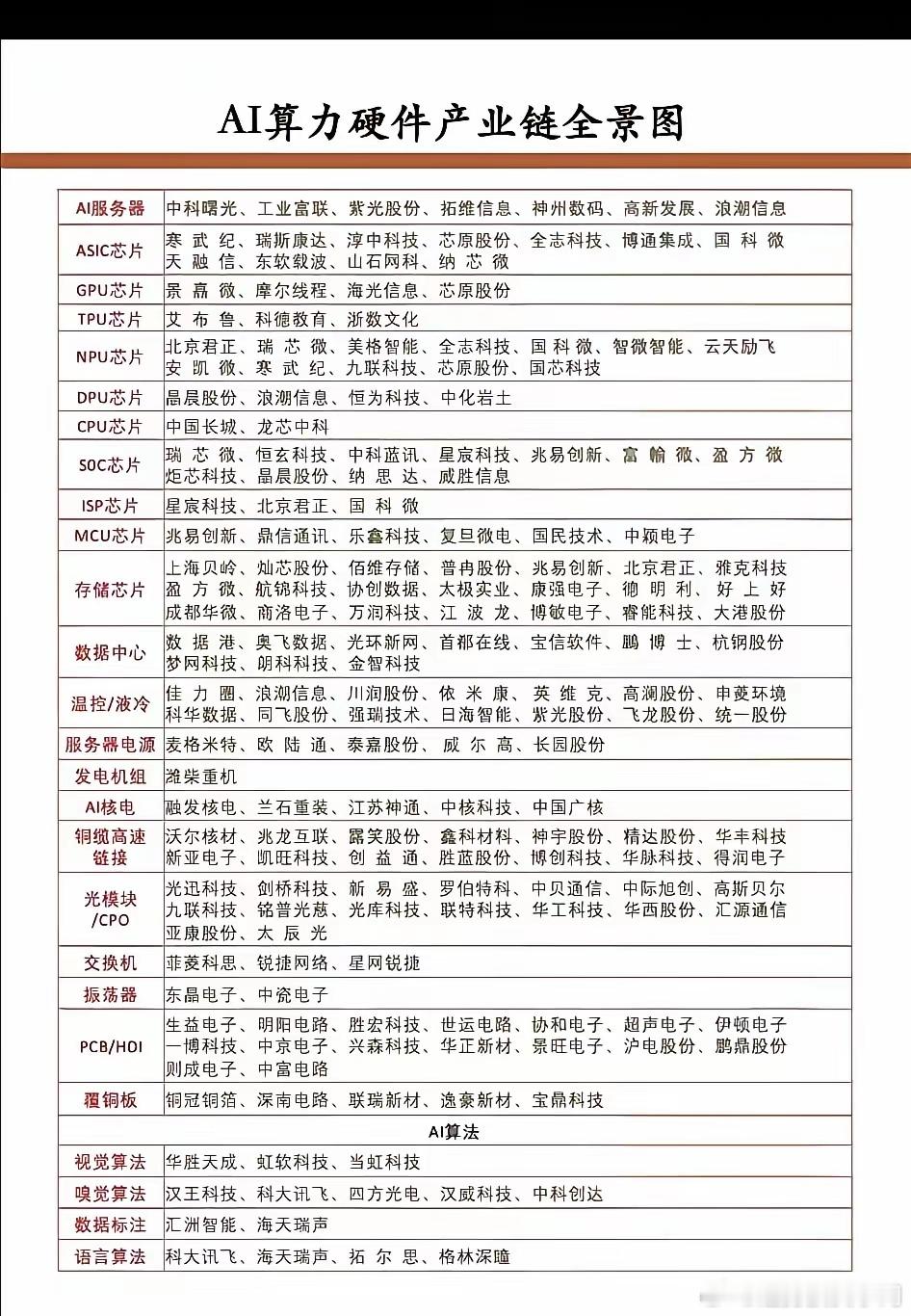

AI智能体现在已经不是单打独斗的工具了,一旦多个智能体要一起干活、参与公司核心流程,问题就来了:怎么管它们?怎么让它们长期靠谱地跑下去? 最近一两年,从各种真实项目AI产品分水岭很清楚:光模型牛不行,光单个Agent聪明也不够。当智能体数量一多、任务开始交叉协作,调度乱了、状态丢了、权限失控了,风险立马爆炸。不少早期产品就是卡在这里,Demo很炫,实际一放大规模就崩。 现在大家越来越明白,真正要解决的是系统级难题。得有个像操作系统一样的框架,把这些智能体统一管起来:谁先跑谁后跑、任务怎么串联、出了错怎么追踪回滚、谁能碰什么数据,全得有规矩。这东西现在叫Agent OS,或者智能体操作系统。它不是再搞个更炫的应用,而是基础设施,重点在可控、可信、能长期稳住。 全网最新情况2025到2026年,企业真正落地并持续跑的,大多集中在金融、医疗、制造这些强监管、高风险、高约束的行业。为什么?因为这些地方容不得乱来,规则严、数据敏感、流程不能断,恰恰逼着大家必须把Agent塞进一套严格的治理体系里,而不是随便堆模型和Prompt。反过来,约束越多,越容易做出能长期用的系统。自由度最高的通用场景,反而落地最慢。 核心观点其实就:AI智能体一定会出错,但关键不是零出错,而是出错可控。靠调度机制、状态追踪、权限分级、审计日志这些操作系统级能力,把风险框在可接受范围内。真正牛的Agent OS,不是吹能力多强,而是规模一大还能让人放心交给它干活。 现在判断一个AI产品行不行,标准已经变了。不再只看“多聪明”,而是看“系统级可信度”够不够。企业客户买的也不是更厉害的AI,而是能长期跑、出了事有底线的系统能力。从模型到Agent,再到Agent OS,这条路是被工程难度、业务风险和真实商业需求一步步逼出来的。未来,谁先把这套治理做好,谁就能站稳脚跟