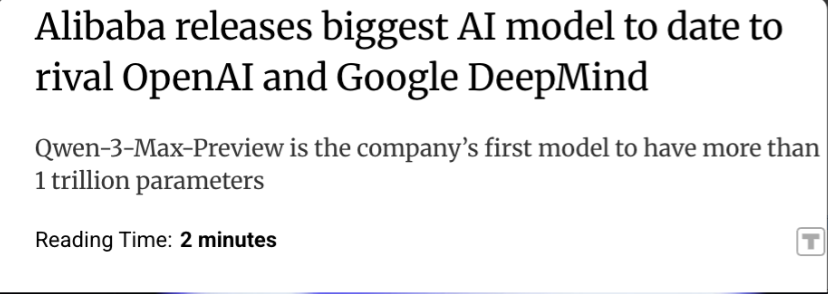

百度文心大模型X1.1推动AI规模化应用,加速产业智能升级 9月9日,WAVE SUMMIT 2025深度学习开发者大会上,百度推出文心大模型X1.1,不仅实现技术能力的多维突破,更在落地应用和产业赋能层面展现出强大潜力。该版本以大模型普惠化为目标,推动AI技术从"可用"走向"好用",为各行各业的智能化转型注入新动能。 作为文心大模型家族的最新成员,X1.1在智能体任务处理、复杂指令遵循和事实性保障等方面取得进步。相比前代,模型在指令遵循精度上提升12.5%,智能体任务完成效率提高9.6%,特别是在多轮交互和工具调用场景中表现尤为出色。这些提升得益于百度采用的迭代式混合强化学习框架,该框架通过混合强化学习策略,同步优化通用任务和智能体任务效果,再通过自蒸馏数据的迭代生产不断提升模型整体表现。 在实际应用层面,X1.1展现出强大的工程化能力。在智能办公场景中,模型可基于天气预警等外部事件自动创建任务、调度资源并发送通知,实现端到端的自动化流程。在内容创作领域,X1.1既能撰写符合社交媒体传播规律的种草文案,也能生成富有情感张力的文学作品。对于企业用户,模型支持构建复杂的数据可视化大屏,生成符合企业级标准的代码,大幅降低开发门槛。 本次升级在推理效率和成本控制方面实现重要突破。通过飞桨v3.2的深度优化,包括动态自适应显存卸载、混合精度训练等关键技术,X1.1在保持高性能的同时显著降低计算资源消耗。特别是在推理环节,模型通过通信存储计算深度协同优化的大规模P/D分离部署等技术,实现吞吐量的大幅提升和响应延迟的显著降低,为用户带来更优的性价比体验。 值得一提的是,百度始终坚持开源开放策略,构建繁荣的开发者生态。继6月开源文心4.5系列模型后,本次大会还推出了轻量思考模型ERNIE-4.5-21B-A3B-Thinking,该模型在保持优秀性能的同时大幅提升推理速度,为中小企业和开发者提供更具性价比的部署方案。同时,通过文心大模型开发套件ERNIEKit和高效部署套件FastDeploy,百度进一步降低了模型应用的技术门槛。 在落地案例方面,文心大模型已经在AI助老、科普教育、智能办公等多个领域取得显著成效,展现出技术赋能社会的巨大价值。 百度通过"芯片-框架-模型-应用"四层全栈布局,构建了完整的人工智能产业生态。从自研昆仑芯、飞桨深度学习框架,到文心大模型和各类AI应用,百度实现了技术栈的端到端优化,为产业智能化提供全面支撑。 文心大模型X1.将进一步助力大模型技术迈向规模化应用新阶段。通过持续的技术创新和生态建设,百度正在推动AI技术从实验室走向产业一线,加速AI原生应用在各行各业落地生根,为中国数字经济高质量发展提供强大助力。

![我就说AI代替不了人类吧[doge]](http://image.uczzd.cn/11168637053587929967.jpg?id=0)